アビッドテクノロジーがカスタマイズされた教育機能を生み出した理由

bsp-admin-1 on December 19, 2012

ブライトコーブのお客様がどのように当社のテクノロジーを活用し、実装によって測定可能なメリットを実現しているかを探るのは、いつも興味深いことです。特に、Avid Technologyが Brightcove をどのように使用しているかを知るのは楽しいことでした。私たちはオンライン動画コンテンツの配信と管理を支援していますが、Avid は多くの場合、動画開発プロセスで使用されるクリエイティブ ツールです。

当社と同じくマサチューセッツ州を拠点とするAvidは、ビデオおよびオーディオ制作技術、特にデジタル・ノンリニア編集システム、管理および配信サービスを専門としています。ハリウッドからマディソン・アベニューまで、クリエイティブ・プロフェッショナルは、ビジュアル・ストーリーテリングのニーズを満たすために、アビッドの製品群を信頼しています。1987年の設立以来、アビッドの技術革新は、アカデミー賞2部門、グラミー賞1部門、エミー賞14部門を含む数百もの賞を受賞しており、同社は、確かに "ビデオ・クレジット "を獲得しています。

では、Avid が Brightcove を選んだ理由は何でしょうか。Avid は動画開発のエキスパートですが、動画配信のベスト プラクティスについては外部の専門知識を求めていました。当社の顧客事例では、Avid と Brightcove の関係についてさらに詳しく説明していますが、この投稿で簡単な概要を説明したいと思います。

基本的に、Avidのオンライン・ビデオへの道は、同社がビデオを含むライブ・ウェブキャスティングのオプションを調査し始めた2010年春に始まります。最終的にAvidは、Flashベースのウェブキャスティング・ソリューションをDIYで構築し、チャットとビデオの両方を組み込んでインタラクティブな体験を実現しました。この知識を手に、同社は、オンデマンドの視聴機能を追加できるオンライン・ビデオ・プラットフォームの調査を開始しました。

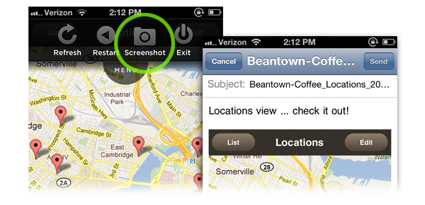

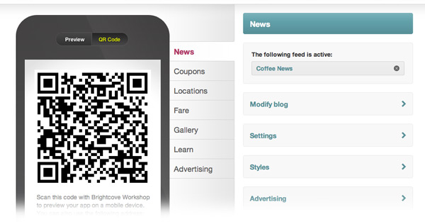

2012 年 3 月、Avid はオンライン動画プラットフォームとして Brightcove を選択しました。それ以来、Avid は Web サイトのヘルプに動画を統合し、Avid ソフトウェア内で作業中に質問が生じたときに、ユーザをチュートリアル動画コンテンツに誘導しています。現在、Avid チームは、動画コンテンツ マーケティング資産を Video Cloud に移行し、簡単に整理・管理できるようにするとともに、モバイル機器向けに最適化できるように取り組んでいます。将来、Avid は Brightcove を活用して動画主導の SEO を改善し、Web サイトにユーザー生成コンテンツを追加する予定です。